エントロピーについての補足記事になります。→エントロピーとは何か?「世界はなぜ乱雑になっていくのか」を説明する物理の重要概念

マクスウェルの悪魔とは何か?

熱力学第二法則に挑戦した有名な思考実験

**マクスウェルの悪魔(Maxwell’s Demon)**とは、19世紀の物理学者 James Clerk Maxwell が提案した有名な思考実験です。

この実験は、自然界の重要な法則である **Second Law of Thermodynamics(熱力学第二法則)**に疑問を投げかける形で考えられました。

簡単に言うと、

「もし分子を見分けられる小さな存在がいたら、エントロピーは減らせるのではないか?」

という問題です。

この思考実験は、エントロピーや情報の概念を理解する上で非常に重要であり、現在では情報理論やコンピュータ科学にも影響を与えています。

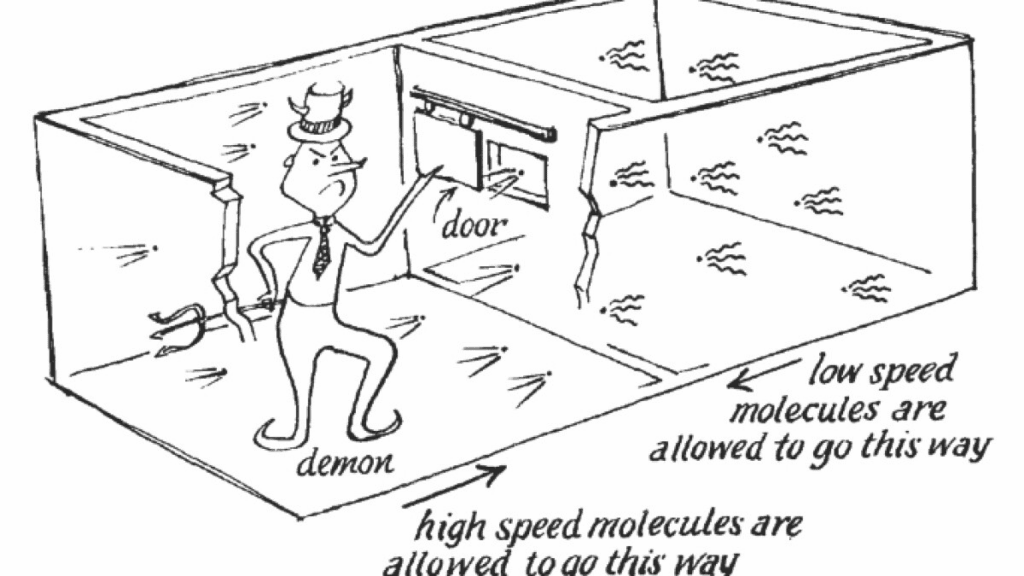

思考実験の内容

マクスウェルは次のような状況を想像しました。

箱を 2つの部屋 に分けます。

[ 部屋A ] | 扉 | [ 部屋B ]

箱の中には 気体分子 が飛び回っています。

気体分子には

- 速い分子(高エネルギー)

- 遅い分子(低エネルギー)

があります。

ここで登場するのが **「悪魔」**です。

この悪魔はとても小さく、次の能力を持っています。

- 分子の速さを見分ける

- 扉を自由に開け閉めできる

悪魔がやること

悪魔は次のルールで扉を操作します。

速い分子が来たら

A → B に通す

遅い分子が来たら

B → A に通す

するとどうなるでしょうか?

時間が経つと

A = 冷たい分子

B = 熱い分子

という状態になります。

つまり

温度差が自然に生まれるのです。

ここが問題

通常、熱は

熱い → 冷たい

方向にしか流れません。

これは 熱力学第二法則です。

しかしマクスウェルの悪魔がいると

温度差を勝手に作れる

ことになります。

これはつまり

- エネルギーを使わず

- 秩序を作り

- エントロピーを減らす

ということになります。

もし本当にできるなら

- 永久機関

- 無限エネルギー

のようなものが作れてしまいます。

つまり

熱力学第二法則が破れる

ことになります。

では悪魔は本当に可能なのか?

結論から言うと

実際には不可能です。

その理由は 情報のエネルギーです。

悪魔は

- 分子の速度を測定

- 情報を記録

- 判断して扉を開ける

必要があります。

この「情報処理」にはエネルギーが必要です。

情報とエントロピー

この問題を解決したのが

Rolf Landauer

の研究です。

彼は次のことを示しました。

情報を消去するときには必ずエネルギーが必要

これを

Landauer’s principle

といいます。

悪魔が情報を処理するたびに

情報の消去

↓

熱が発生

↓

エントロピー増加

が起きます。

つまり

悪魔を含めた全体ではエントロピーは増える

ため、熱力学第二法則は破れません。

マクスウェルの悪魔が重要な理由

この思考実験は、単なる空想ではありません。

現代科学では

- 情報理論

- コンピュータ科学

- 量子力学

- ナノテクノロジー

などに大きな影響を与えています。

特に重要なのは

「情報も物理量である」

という考え方です。

つまり

情報 = エネルギーと関係する

ということです。

この考え方は、コンピュータの消費電力や量子コンピュータの研究にもつながっています。

まとめ

マクスウェルの悪魔とは、19世紀に提案された有名な思考実験であり、エントロピーと熱力学第二法則を理解するための重要な概念です。

この実験では、分子を見分ける「悪魔」がいれば温度差を作り出し、エントロピーを減らせるように見えます。しかし実際には、情報を処理するためのエネルギーが必要であり、全体としてはエントロピーは増加します。

この議論から生まれた「情報と物理の関係」は、現代科学において非常に重要なテーマとなっています。マクスウェルの悪魔は、単なる思考実験でありながら、私たちの宇宙の基本法則を深く理解するための鍵となるアイデアなのです。

情報エントロピーとは何か?

情報の「不確実さ」を表す数学的な指標

情報エントロピーとは、情報の不確実さやランダムさの度合いを数値で表したものです。簡単に言えば、「どれだけ予測が難しいか」を測る量です。この概念は1948年にアメリカの数学者 Claude Shannon が提唱した **Information Theory(情報理論)**の中心的な概念であり、現代の通信技術、コンピュータ科学、データ圧縮、暗号などに広く応用されています。

物理学で登場する **Entropy(エントロピー)**が「乱雑さ」を表す量であるのと同様に、情報エントロピーは「情報のランダムさ」を表すと考えることができます。

情報とは「予測できないこと」

まず、情報とは何かを考えてみましょう。情報理論では、予測できない出来事ほど情報量が多いと考えます。

例えばコイン投げを考えます。

結果は

- 表

- 裏

のどちらかです。このとき、結果は完全にランダムなので予測はできません。そのため、結果が出た瞬間には「新しい情報」が得られます。

一方で、次のような場合を考えてみます。

- 必ず表が出るコイン

この場合、結果は最初から分かっています。したがって、新しい情報はほとんど得られません。

つまり、

- 予測が難しい → 情報量が多い

- 予測が簡単 → 情報量が少ない

という関係になります。

情報エントロピーの意味

情報エントロピーとは、ある出来事の結果がどれだけ不確実かを表す量です。

例としてサイコロを考えます。

6面サイコロの場合、結果は

1・2・3・4・5・6

の6通りあります。

すべて同じ確率で出るため、結果を予測するのは比較的難しくなります。この場合、情報エントロピーは高い状態になります。

一方で、もしサイコロが細工されていて

- 1が90%

- その他が10%

だとすると、結果はかなり予測しやすくなります。この場合、情報エントロピーは低くなります。

つまり

結果が均等なほどエントロピーは高くなる

という特徴があります。

情報エントロピーの式

シャノンは情報エントロピーを次の式で定義しました。

H = − Σ p(x) log₂ p(x)

ここで

- H:情報エントロピー

- p(x):ある出来事が起こる確率

を表します。

この式は少し難しく見えますが、意味は単純です。

確率が低い出来事ほど、得られる情報量が大きい

という考え方を数学的に表しています。

例えば

- 必ず起こる出来事 → 情報量はほぼ0

- 滅多に起こらない出来事 → 情報量が大きい

という関係になります。

データ圧縮との関係

情報エントロピーは、データ圧縮技術の基礎にもなっています。

例えばテキストデータでは、文字の出現頻度に偏りがあります。

英語では

- e

- t

- a

などの文字がよく使われます。

一方で

- z

- q

などはあまり使われません。

このような頻度の違いを利用すると

- よく出る文字 → 短いコード

- あまり出ない文字 → 長いコード

という形でデータを効率よく圧縮できます。

この考え方を利用したのが

- ハフマン符号

- ZIP圧縮

- PNG画像圧縮

などの技術です。

情報エントロピーと物理エントロピー

情報エントロピーは、物理学のエントロピーと深い関係があります。

物理エントロピーは、分子の配置の「可能な状態数」を表す概念です。分子の並び方が多いほど、エントロピーは高くなります。

情報理論でも同じで、結果の可能性が多いほど不確実性が高くなり、エントロピーが大きくなります。

この関係は、先ほど説明した マクスウェルの悪魔の議論でも重要な役割を果たしています。情報を処理すること自体が、エネルギーやエントロピーと関係しているのです。

情報エントロピーの応用

情報エントロピーは、現代の多くの技術で利用されています。

代表的な例としては次のようなものがあります。

通信技術

ノイズの多い通信環境でも、効率よく情報を送る方法の設計に使われます。

データ圧縮

ファイルサイズを小さくするアルゴリズムの基礎となっています。

暗号技術

ランダム性の高い鍵を作るために利用されます。

人工知能

機械学習では、不確実性を評価するためにエントロピーが使われます。

まとめ

情報エントロピーとは、情報の不確実さやランダムさを数値で表す指標です。この概念はシャノンによって提唱され、情報理論の基礎となりました。

結果が予測しにくいほど情報量は増え、情報エントロピーは大きくなります。逆に、結果がほぼ決まっている場合には情報エントロピーは小さくなります。

この考え方は通信技術、データ圧縮、暗号、人工知能など、現代の情報社会を支える多くの技術の基盤となっています。また、物理学のエントロピーとも深い関係があり、情報とエネルギーの関係を理解する上でも重要な概念です。

情報エントロピーは、私たちの世界における「情報の秩序とランダムさ」を理解するための重要な鍵となる考え方なのです。

コメント